本文將簡介何謂公開來源情資蒐集(OSINT)、生成式AI、假資料的可能造成的影響性以及生成式AI與OSINT的關聯。除此之外,也會實際操作並情境演練,詳細說明如何透過AI or Not和Illuminarty等兩款工具來驗證圖片資料的真偽。

在資訊時代,隨著網路的快速發展,人們已經習慣從網路中獲取資訊。然而,在海量資訊的湧入為人們帶來方便和便利的同時,也帶來一個嚴峻的問題:資訊真實性的挑戰。

知名諮詢公司Gartner認為,在2030年時,在AI的訓練資料使用上,非真實的資料將會超越使用真實資料的資料量。因此,從此趨勢觀察,網路上將會充斥著越來越大量的非真實資料,也就是說,網路上的假資訊數量是日益劇增的。而由於資訊的快速流通和廣泛傳播,使得虛假資訊和誤導性資料容易在網路上迅速擴散,這些訊息時常誤導人們的思維和認知。

與此同時,近幾年的突破性技術-生成式人工智慧(Generative AI)的快速發展也引起了廣泛的關注。舉例來說,ChatGPT的問世為人們提供了更方便的途徑以解決生活中碰到的問題。然而,與資訊真實性的挑戰相伴而生的是,生成式AI產生的並非全部都是真實資料,而是所謂的假資料,這進一步加劇了網路上虛假資訊的氾濫。因此,必須仔細檢查和驗證,有效的資料驗證也是確保公開來源情資蒐集(OSINT)所獲得資訊品質不可或缺的步驟,運用現有的技術和方法確保所收集的資料為真實可靠的,避免因為錯誤資訊而做出錯誤判斷。

背景知識說明

先簡介什麼是OSINT與其欲探討的議題以及其流程,接著介紹生成式AI,並引出其對OSINT所造成的正負面影響。

OSINT與流程介紹

公開來源情資蒐集(Open Source Intelligence,OSINT),通常指的是利用公開可用的技術來收集情資和研究特定主題或目標和方法。值得一提的是,OSINT的資訊並非完全免費,有些時候也會需要靠一些付費的工具或軟體來取得資訊。此外,這些資訊可以來自各種來源,包括網際網路、社交媒體、新聞、政府文件、學術研究等。此外,資料和資訊是兩個相關但又不同的概念,兩者之間存在的重要區別整理如表1所示。

綜上所述,資料可說是資訊的前身,它們之間的關係是資料經過加工和處理後轉化成資訊。資訊比資料更有實際的意義和價值,能夠提供人們更多的幫助和指引。而關於OSINT的流程,主要可以切分為五個流程,分別為:計畫、收集、分析和處理、發送和回饋。該流程會因不同組織的不同目的和要求進行修改。不過,基本上都會遵循以下五個步驟,且是不斷循環的過程,故該過程也被稱為OSINT週期(圖1):

圖1 OSINT週期。

圖1 OSINT週期。

1. 計畫(Planning):確定需要收集資訊的目標,明確定義想要瞭解的主題、實體或事件。

2. 收集(Collection):使用合適的工具和資源,採用不同的搜索關鍵詞、搜索引擎和搜尋技術等手段,以獲得更全面的資料。

3. 分析(Analyzing):從收集而來的資料進行處理和提煉,過濾大量不實用的資料,來獲取有意義的資訊。

4. 發送(Dissemination):將分析得到的資訊進行整理,讓資訊得以清楚地呈現並吻合最初設定的目標方向。

5. 反饋(Feedback):對整個事件過程進行檢討,以作為下次改善的目標。

資料驗證的重要性

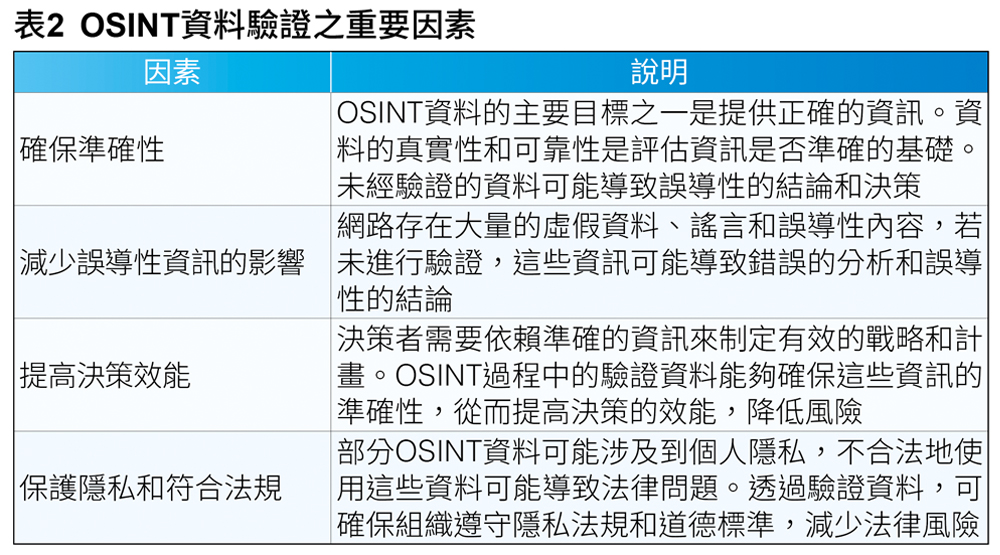

在網路上用不同的方式做公開來源情資蒐集時,若蒐集回來的資料為假資料,在前段所述的分析步驟中便會遇到很大的挑戰,正所謂「垃圾進,垃圾出(Garbage in Garbage out)」,因此在做資料分析之前,很重要的過程是要學習如何過濾有效且正確的資料,降低因虛假或不準確資訊而做出錯誤決策的風險。表2所示是需要在公開來源情資蒐集時做資料驗證的幾個重要因素。

生成式AI

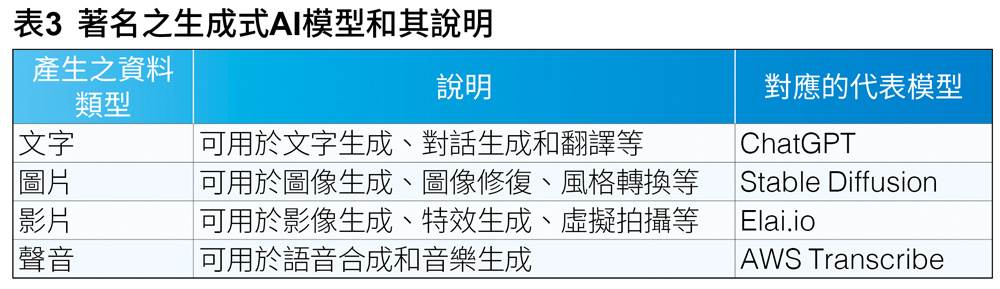

生成式AI可以說是2023年討論度最高的技術之一,若不探討其較深層的實現技術,單就一般使用者的角度切入思考,其本質上是一種可以藉由人工智慧回覆和創造資料的方式。著名的生成式AI模型像是ChatGPT、Stable Diffusion等都是非常有名基於生成式AI的框架所建構出來的模型。可以發現,其主要的特色是透過模仿人類的思維過程和創造能力來生成新的內容,這些內容舉凡文字、圖片、影片、聲音等皆有不同對應的生成式AI模型可以生成。

生成式AI模型會透過人類給它的提示詞(Prompt)來創造新的內容,這種被創造出來的內容可以是完全原創的,也可以是基於現有資訊的修改或擴展。這裡將生成式AI在各個領域的應用和對應較有名的生成式AI模型或工具整理成表3。

生成式AI與OSINT的關連

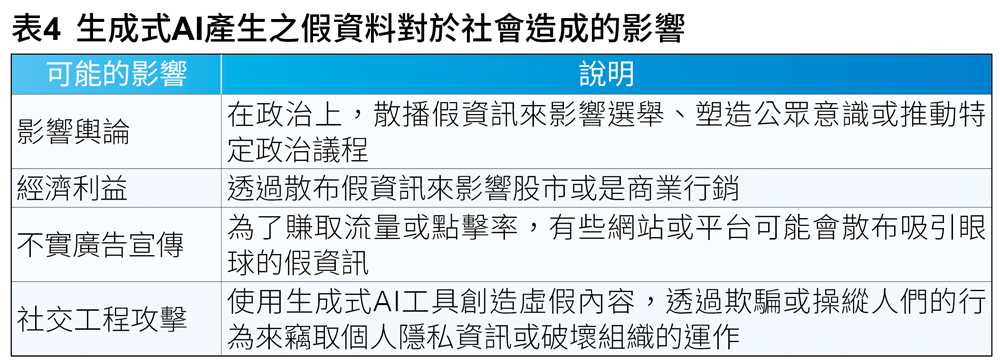

OSINT與生成式AI這兩個看似毫無關聯的主題,實際上有著高度的相關。原因如前面提及OSINT於資料分析的過程中若是參雜假資料,對分析人員來說勢必是一道難解的題目。因為,生成式AI產生的不管哪一種型態的資料,其本質上都是屬於假資料,因此生成式AI對於OSINT的過程來說是一把雙面刃。

生成式AI可以讓產生資料的過程變得更加便利,但同時也因為產生越來越多的非真實資料,反而對分析資料增加了不少的麻煩和潛在的威脅。所以,在收集公開資料時,調查人員必須對資料進行詳細的審查,避免遭到不實資訊的誤導。這些由生成式AI產生的假資料可能會對社會造成多方面的影響,將其整理如表4所示。

實際操作與模擬情境

在實際操作方面,將使用圖片驗證作為舉例,介紹兩個工具的使用方法,分別是AI or Not和Illuminarty,這兩款工具皆是用來判斷圖片是否為AI生成的工具,以下先針對這兩款工具進行介紹。

工具介紹

首先,介紹AI or Not和Illuminarty這兩款工具。

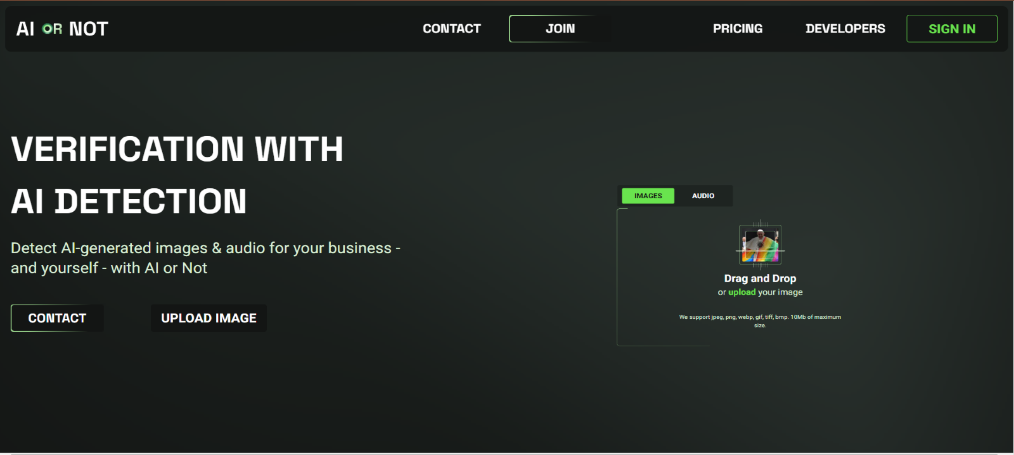

美國的Optic公司開發了一個名為「AI or Not」的網站。該網站的主要功能是幫助使用者辨別一段文字或一張圖片是否是由AI生成。使用AI or Not的方式相當容易,使用者只須將想要檢查的文字或圖片上傳到網站上,系統便會自動分析並在幾秒內取得結果,以判斷該段文字或該圖片是否為AI生成的。

其主要可以分成免費和付費的版本,免費的版本主要是針對圖片和影片做檢查,然而每個月的檢查次數是較少的,若使用付費的方案,則會根據不同的方案解鎖不同的功能,例如告訴使用者若是AI生成的圖片,其生成的來源可能是Midjourney、Dall-E或Stable Diffusion等常見的生成式AI模型。本次要使用的功能僅須使用到其免費的功能,因此不必額外購買付費版。AI or Not的網址為「https://www.aiornot.com/」,其首頁畫面如圖2所示。

圖2 AI or Not網站首頁。

圖2 AI or Not網站首頁。

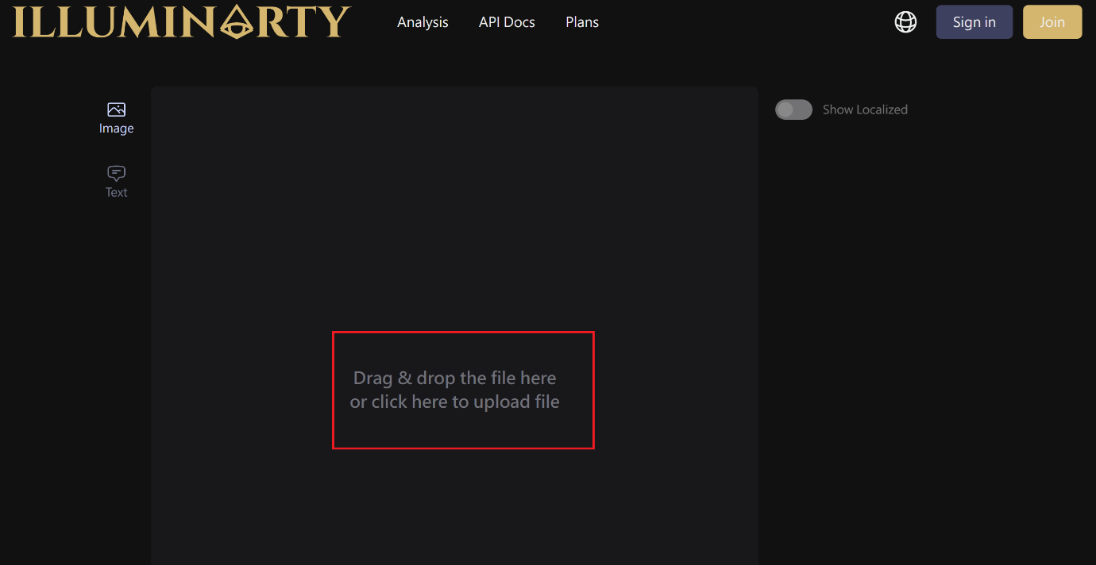

Illuminarty也是一款網頁型的工具,其與AI or Not皆是可以用來檢測是否為AI生成、合成和篡改的圖片,但Illuminarty能夠檢測Deepfake過後的圖片。Illuminarty主要分成免費版和付費的版本,若使用免費版的功能,則僅有簡單的AI文字和AI圖片的分類,倘若是付費的版本,則依據購買的方案開通進階功能,如AI圖片辨識和使用其提供的API等。本文範例只須使用免費的功能即可,不必額外購買付費方案。

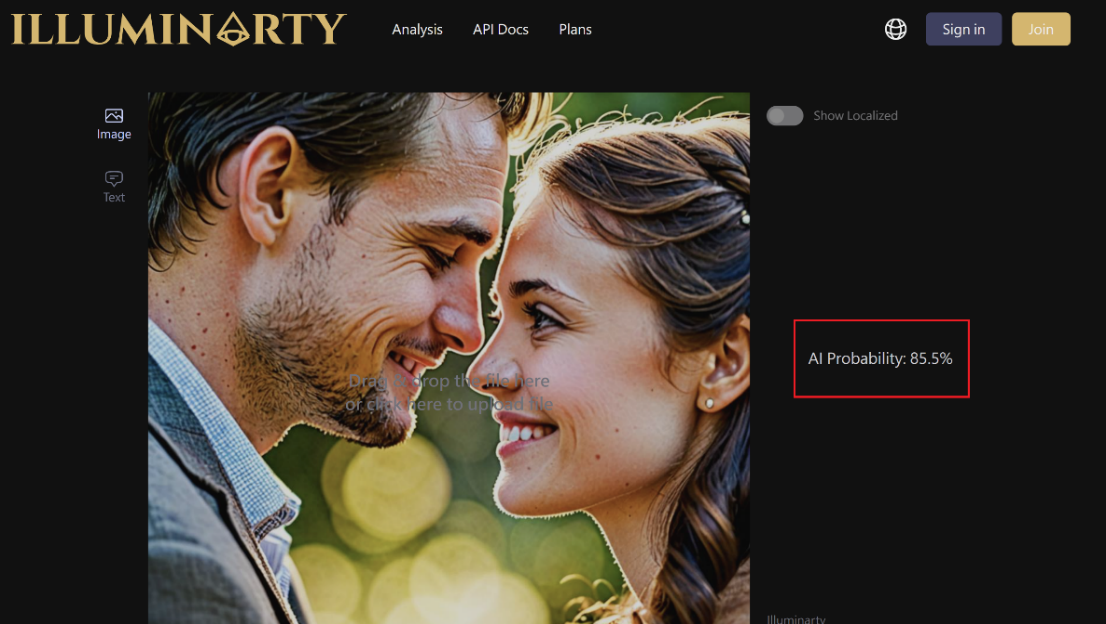

另外,Illuminarty顯示的輸出結果與AI or Not相同,皆是以百分比的方式呈現,並非屬於二元分類法,因此使用者可以根據結果並搭配其他工具的資訊以做出較為精確的判斷。Illuminarty的首頁網址為「https://app.Illuminarty.ai/」,如圖3所示。

圖3 Illuminarty首頁畫面。

圖3 Illuminarty首頁畫面。

模擬情境

在一場熙攘的董事長爭奪中,小伊作為候選人小宥的幕僚,負責開放式情報(OSINT)的蒐集與分析工作,這是一項確保小伊在競選中取得成功的關鍵之一。

一天,當小伊正在進行網路上的消息追蹤時,發現了一條引人注目的消息:有人聲稱在某個國外景點中,拍到小宥與一位女性友人舉止曖昧,雖然照片並未拍攝得相當清楚,但這條消息迅速在社交媒體上蔓延開來,引起不小的轟動。小伊深知,這條消息如果屬實的話,對有家室的小宥來說,無疑是一大打擊,會讓他的支持率急劇下降。

身為專家的小伊也知道,不能輕信網路上的所有消息,必須先進行仔細的驗證。她向小宥報告時,小宥表現出一貫的冷靜和信任,並表示他對自己的言行始終抱持著高度的誠實和負責,他絕無做過類似的出軌情事。於是小伊立刻展開調查,透過追蹤消息的來源,她發現這條消息是由一個不知名的網路帳戶所發布。分析該帳戶的歷史活動,發現它曾多次散布類似的不實消息,而且在許多情況下都被迅速揭露為虛假的。

小伊透過自身的專業,使用AI or Not和Illuminarty兩個識別是否為AI生成的工具,對照片進行剖析,發現照片中小宥的人臉部分,為AI生成的可信度相當高,小伊將一系列操作過程整理成如下的步驟:

1.初步分析:小伊首先使用AI or Not工具,對照片中的人臉進行初步檢查。

2.深入驗證:隨後,小伊使用Illuminarty工具進行更深入的驗證。

3.圖片背景調查:小伊也檢查了照片的背景,發現背景中的一些細節,例如燈光和陰影,與該景點的實際情況不符,這也為照片的造假提供了更多證據。

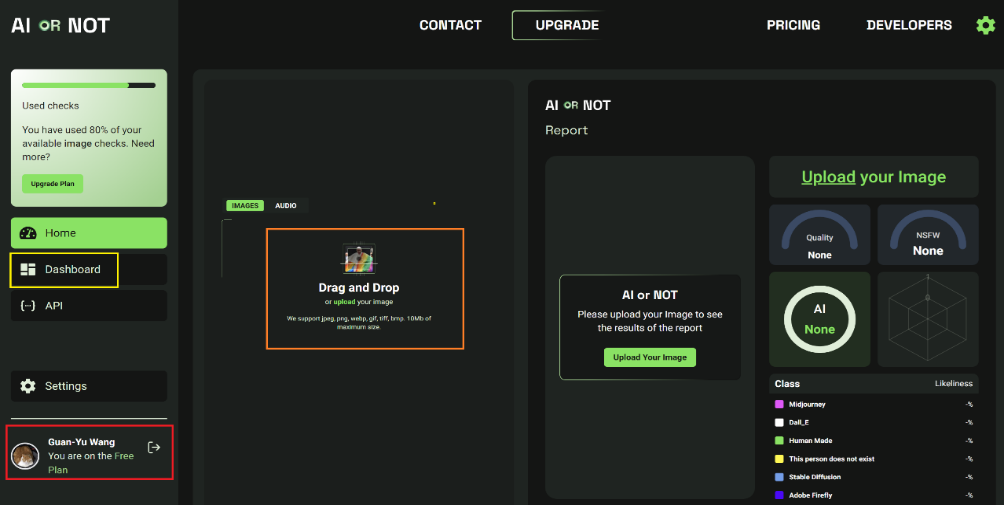

以下為小伊實際操作的過程,接著詳細說明。首先,透過網址「https://www.aiornot.com/」進到首頁。接著,進行帳戶的註冊,可直接使用第三方的驗證如Google帳戶等,也可以自行建立帳號和密碼,若成功註冊和登入完成,頁面左下角會顯示註冊的名字,如圖4所示,且預設上是使用免費的方案。

圖4 註冊並登入AI or Not。

圖4 註冊並登入AI or Not。

下一步,準備好要分析的圖片,也就是疑似小宥舉止曖昧的照片,然後小伊點擊圖4中的Drag and Drop,將該圖片上傳至AI or Not。上傳完成後,選擇圖4左側的Dashboard以查看分析的結果。

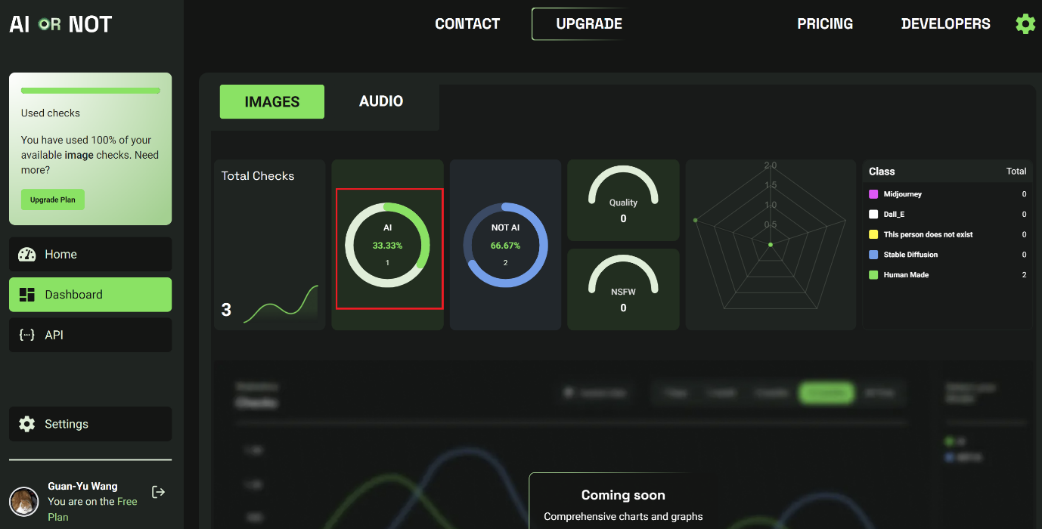

從分析的結果來看,目前總共檢查過的圖片有三張,而小宥這張疑似舉止曖昧的照片一上傳之後,該可能為AI生成之照片的數量變成1,如圖5中的框選所示,這表示小宥這張圖片很有可能是由AI生成的。

圖5 使用AI or Not檢測圖片。

圖5 使用AI or Not檢測圖片。

然而,小伊做事情一向講求謹慎,因此又特別找了另一個驗證的網站Illuminarty。同樣地,先透過網址「https://app.Illuminarty.ai/」連接到網站。該網站可以不經登入便進行圖片分析,因此直接點選中間的Drag & drop上傳圖片(圖6)。

圖6 使用Illuminarty上傳圖片。

圖6 使用Illuminarty上傳圖片。

成功上傳圖片後,如圖7所示,在右邊欄位中會顯示該圖片可能是AI生成的機率有多少。Illuminarty認為該張照片可能為AI生成的機率頗高,達85.5%。

圖7 Illuminarty產生的顯示結果。

圖7 Illuminarty產生的顯示結果。

最後,小伊綜合AI or Not和Illuminarty的結果,推論此次事件是有人惡意抹黑小宥,而小伊的調查結果最後也證明了這條消息的不實性,並成功地化解這場危機,保障了小宥在這次爭奪中的聲譽和優勢。

結語

本文簡介OSINT的基本概念和其週期,也講述資料驗證的重要性。同時,也探討了生成式AI的基礎知識以及其對OSINT的影響,特別是在產生虛假資料方面的影響。生成式AI的發展雖然帶來了便利,但也帶來了新的挑戰,需要加強監管和管理,以及提高普羅大眾對於網路上假資料的警覺性。

<本文作者:社團法人台灣E化資安分析管理協會(ESAM, https://www.esam.io/)中央警察大學資訊密碼暨建構實驗室 & 情資安全與鑑識科學實驗室(ICCL & CFORENSICS)1998年12月成立,目前由王旭正教授領軍,並致力於資訊安全、情資安全與鑑識科學,資料隱藏與資料快速搜尋之研究,以為人們於網際網路(Internet)世界探索的安全保障(https://hera.secforensics.org)。>