人工智慧發展的角度越來越廣,根據調查,該技術的市場規模將從2023年的1,500億美元增加到2026年的3,000億美元,吸引大型科技業者與新創爭相投入。不過,人工智慧除帶來便利性與產業轉型外,同時也引進新風險,從道德困境和隱私問題到潛在的財務損失與聲譽損害等。

人工智慧發展的角度越來越廣,根據調查,該技術的市場規模將從2023年的1,500億美元增加到2026年的3,000億美元,吸引大型科技業者與新創爭相投入。不過,人工智慧除帶來便利性與產業轉型外,同時也引進新風險,從道德困境和隱私問題到潛在的財務損失與聲譽損害等。因此,人工智慧治理可視為「治本」的關鍵,確保人工智慧技術的開發、部署和利用不僅能夠促進創新,還能降低新出現的風險,從而保護企業與國家免受潛在不利結果的影響。

科技發展過快使得監理機制落後

然而,根據人工智慧風險與安全(AIRS)團體調查指出,治理需求與其實際執行間存在顯著差距:僅有30%的企業明確訂定人工智慧系統的角色與職責,且只有不到20%的業者擁有專門負責人工智慧治理的管理部門,這種差異凸顯產業界對治理工具的迫切需求,以確保人工智慧的未來值得信賴。

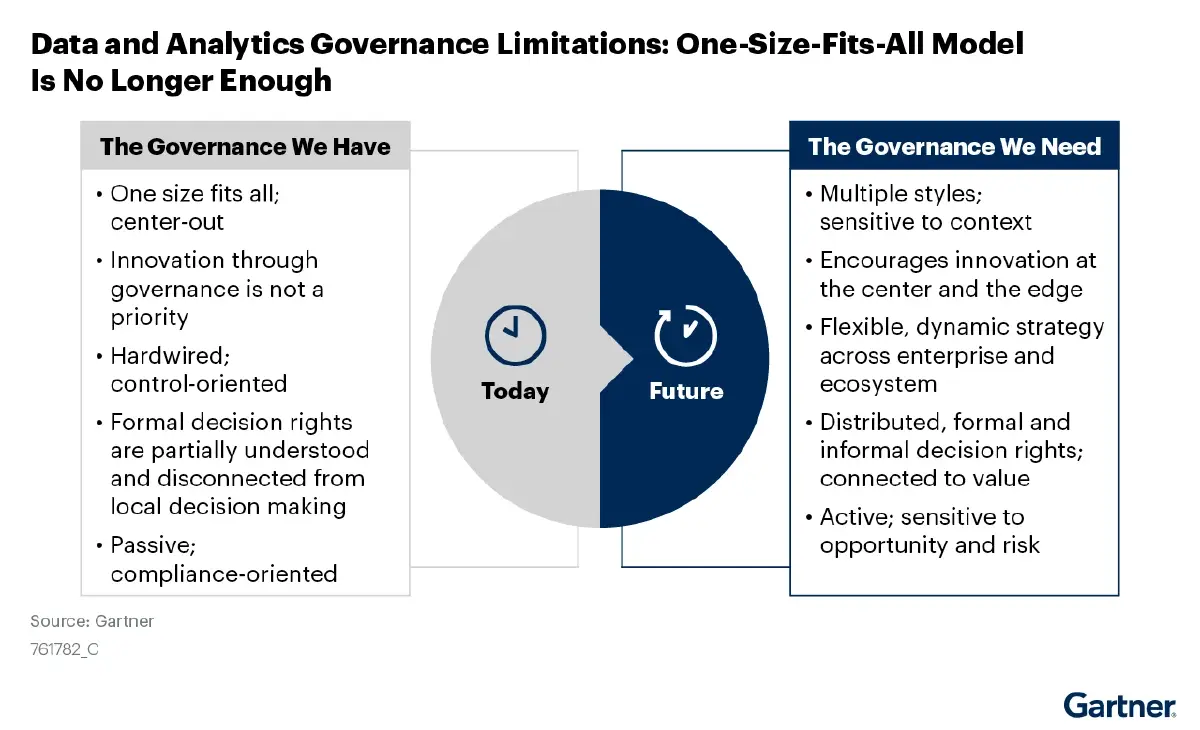

Gartner認為當前的科技管理框架仍有許多地方需要改善。(資料來源:Gartner)

Gartner認為當前的科技管理框架仍有許多地方需要改善。(資料來源:Gartner)

此外,調研機構Gartner也指出,到2027年,80%的數據和分析(D&A)治理舉措將因缺乏真實或人為的危機而失敗,企業需要更先進的治理框架,來應對各種科技的管理。

從歐盟做法思考建立AI框架的完整性

烏克蘭戰爭已經成為科技巨頭的人工智慧戰爭實驗場所,如Palantir、微軟、亞馬遜、Google、Clearview AI等公司與烏克蘭武裝部隊合作,為烏克蘭抵禦俄羅斯的侵略提供先進技術和支援,這項合作使烏克蘭成為測試軍事技術的實驗室,包括人工智慧、無人機和臉部辨識軟體,烏克蘭國防軍和科技巨頭之間的這種密切合作夥伴關係不僅可解決當前的衝突,而且未來在烏克蘭重建科技產業時,這些科技巨頭也能從中分一杯羹。

然而,越來越多的軍事人工智慧技術實驗凸顯了戰時使用這些技術的複雜性和倫理問題,不少政府與機構認為,科技公司成為擁有巨大權力的獨立參與者,而軍事決策可能最終會交由演算法處理。

同時,在全球人工智慧霸權爭奪中,包括歐盟在內的所有主要經濟體都在熱切地爭取自己的技術實力和領先地位,美國透過在該領域的投資總額領先全球:2022年,美國獲得474億美元的人工智慧投資,大約是第二大貢獻者中國(中國的134億美元)的3.5倍,美國也是新融資人工智慧公司數量最多的國家,幾乎是歐盟和英國總和的兩倍,是中國的3.4倍。

根據AI Watch稱,美國在人工智慧研發和人工智慧相關補充資產上的支出幾乎是歐盟的兩倍,人均支出是歐盟的2.7倍,這讓歐洲陷入焦慮,歐盟執委會已採取多項措施來推動人工智慧技術發展:地平線2020計畫在2018-2020年為人工智慧撥款15億歐元(16億美元);作為歐盟2021-2027多年預算的一部分,數位歐洲計畫額外投入25億歐元(27億美元)用於投資和開放企業和公共管理機構使用人工智慧,但這遠遠不夠。

因此,歐盟決定以法規來管理人工智慧,希冀能同時解決地緣政治、經濟和監管問題,為此,歐盟制定《人工智慧法案》來因應,該法案目的為根據風險等級以規範人工智慧的使用,展現以人為本、負責任的人工智慧發展的做法。此外,歐盟對本土人工智慧創新的追求也顯現了人工智慧在加強歐洲技術主權和減少戰略依賴方面的至關重要性。

事實上,歐盟期望透過《人工智慧法案》建立全球標準視為關鍵目標,引發業界與政府針對監管競賽的討論,一方面顯示人工智慧監管的重要性,另一方面也顯示歐盟將在全球範圍內發揮巨大影響力,透過監管來阻止其他國家人工智慧過度發展。然而,在全球人工智慧霸權之爭中,歐洲在維持技術優勢方面面臨挑戰,雖然《人工智慧法案》的做法能對全球市場產生重大影響,但僅靠歐洲的努力無法為人工智慧建立全面的國際標準。

其他地區與國家的做法為何?

除歐盟外,各種多邊組織都發布了人工智慧治理原則,例如經濟合作暨發展組織(OECD)的人工智慧原則、聯合國教育、科學及文化組織對人工智慧倫理的建議,以及歐盟的可信賴人工智慧道德準則,而國際人權機構歐洲委員會於2022年初成立人工智慧委員會,制訂《人工智慧、人權、民主和法治框架公約》來約束人工智慧的野蠻成長。

另外,如美國也宣布成立人工智慧安全研究所聯盟,由美國人工智慧安全研究所(USAISI)主導,該聯盟將整合人工智慧開發者、研究人員、政府官員、產業專家和民間社會代表,支持推動安全可信任人工智慧的開發和實施,拜登的行政命令指出,該聯盟將在採取優先行動方面發揮關鍵作用,例如制訂紅隊指南、進行能力評估、管理風險、確保安全以及實施合成內容驗證措施。

而英國於2023年11月主辦了人工智慧安全峰會,該峰會聚集了政府高級官員、主要人工智慧公司的高階主管和民間社會領導人,為全球人工智慧安全奠定了基礎。各國對人工智慧安全制度的想法的結果是《布萊契宣言》,這是28個政府和領先人工智慧公司的聯合承諾,呼籲先進的人工智慧模式在部署之前應接受安全檢查。

最後,科技巨頭也提出各種人工智慧原則,例如微軟Azure的原則為公司人工智慧的開發和應用提供指南,而Google的道德人工智慧原則為評估新的人工智慧產品和功能提供框架。其他案例包括亞馬遜對負責任地使用人工智慧技術的承諾以及OpenAI的人工智慧安全方法。同時,世界經濟論壇的「全球人工智慧治理聯盟」是一項聯整合企業、政府、學術機構和民間社會的倡議,呼籲建立負責任的全球設計和發布透明和包容性的人工智慧軟體。

事實上,許多業者在使用與開發人工智慧前應該有一套自己針對治理框架的論述,上述許多國家做法可作為借鑑,由於預計未來人工智慧的成長速度只快不慢,企業要如何善用科技同時也需要有科技管理能力,人工智慧框架或許就是最好答案。

<本文作者:Abby Lin現為政策暨市場分析師>